多模态- Multimodal Model

在 生成式 AI(Generative AI, GenAI) 中,Multimodal Model(多模态模型) 是指能够处理并生成多种不同模态的数据类型的人工智能模型。简单来说,这类模型能够结合多种不同类型的输入(例如文本、图像、音频、视频等),并基于这些输入生成不同类型的输出。这种能力在许多应用场景中极为重要,因为人类的感知和理解通常是多模态的。

模态(Modalities) 是什么?

在机器学习和人工智能中,模态指的是数据的不同类型或形式。常见的数据模态包括:

- 文本:自然语言,例如文章、对话等。

- 图像:静态图片,如照片、图形等。

- 视频:动态视觉内容,序列化的图像。

- 音频:语音、音乐或其他声音信号。

- 传感器数据:如温度、运动、GPS 等数据。

每一种模态都有其独特的数据结构和特征。传统的 AI 模型通常只能处理单一模态的数据,而多模态模型能够融合和处理来自多种模态的输入。

Multimodal Model 的工作原理

多模态模型通常结合多个独立的神经网络模块,每个模块专门用于处理一种模态。例如,一个多模态模型可能会结合一个 卷积神经网络(CNN) 用于图像处理和一个 Transformer 用于文本处理。然后,这些独立处理的模态信息会通过某种形式的融合机制进行整合,模型可以基于这些融合后的信息进行预测、生成或者分类。

多模态模型的核心挑战在于如何跨模态对齐和融合信息。例如,在图像和文本结合的模型中,如何使模型理解文本描述与图像内容之间的关联是关键问题之一。

Multimodal Model 的应用场景

-

图像-文本生成与理解:

- 文本生成图像:如 OpenAI 的 DALL·E 模型,它能够根据输入的文本描述生成图像。用户输入一段文字描述(如“骑着蓝色摩托车的小猫”),模型会生成一张与描述相符的图片。

- 图像生成文本:如 图像描述生成 模型(image captioning),它可以根据一张图片生成对应的自然语言描述。这在无障碍访问(例如帮助视障人士描述图片内容)中具有广泛的应用。

-

视频理解与生成:

- 多模态模型可以从视频和音频中同时提取信息,理解语境并生成相应的文本或新的视频。例如,它可以分析一段视频并生成视频的摘要,或者基于视频生成对应的字幕。

-

语音与文本处理:

- 在语音助手中,多模态模型能够处理语音输入,并结合文本信息做出更准确的响应。语音识别技术和自然语言生成技术的结合就是多模态模型的典型应用。

- 例如,AI 能够根据语音命令来控制图像的生成或操作。

-

视觉问答(Visual Question Answering, VQA):

- 在 VQA 系统中,模型会基于图像和文本输入来回答问题。用户向系统提供一张图片和一个与之相关的问题,模型会分析图像和问题文本,提供准确的答案。比如,给定一张图片和问题“这张图片里有多少只猫?”,模型将分析图片并返回正确的数字。

-

增强现实(AR)和虚拟现实(VR):

- 多模态模型在 AR/VR 中可以帮助创建更加沉浸式的体验。例如,模型可以结合用户的手势、语音、环境感知等多模态信息,实时生成虚拟内容并进行交互。

-

跨模态生成(Cross-modal generation):

- 在跨模态生成中,模型可能接收一种类型的输入并生成另一种模态的输出。例如,输入文本生成音乐,或输入图像生成音频描述。

Multimodal Model 的优势

-

增强理解和生成能力:

- 多模态模型可以结合来自不同模态的数据,提供更加丰富和全面的理解。例如,结合图像和文本信息的模型可以在复杂场景下提供比仅处理图像或文本更好的结果。

-

提高泛化能力:

- 由于模型在训练时能够同时处理不同类型的数据,因此多模态模型在应对新的场景或任务时往往比单模态模型更具泛化能力。

-

更加自然的人机交互:

- 人类的交流方式是多模态的(我们使用语言、视觉线索、声音等进行交流),多模态模型能够通过整合这些模态数据,提供更加自然、直观的人机交互方式。

Multimodal Model 的挑战

-

数据对齐和融合:

- 不同模态的数据通常有不同的结构和时间顺序(例如音频和视频数据的对齐),如何将这些数据进行有效对齐和融合是多模态模型的一个难点。

-

计算复杂性:

- 处理多种模态的数据需要更大的计算资源,因为模型不仅要理解每种模态的数据,还要整合它们。这会导致模型的复杂性和计算需求显著增加。

-

数据稀缺性:

- 尽管许多单模态的数据(如图像或文本)已经被广泛标注和收集,但多模态的数据集(如图像-文本配对、视频-音频配对)相对较少。建立大规模的高质量多模态数据集仍是一个挑战。

Multimodal Model 示例

-

CLIP(Contrastive Language-Image Pretraining):

- 由 OpenAI 开发,CLIP 是一种图像-文本联合训练的模型,它能够理解图像和文本之间的关系,并在没有专门训练的情况下执行多种任务,如图像分类、图像搜索和图像生成。

-

DALL·E:

- OpenAI 也开发了 DALL·E,它能够根据文本描述生成图像,是一个经典的多模态生成模型。

-

Flamingo(DeepMind):

- Flamingo 是一种能够处理图像和文本输入的多模态模型。它在处理和生成文本与图像结合的任务中表现出色,如视觉问答和图像描述。

总结

在生成式 AI(GenAI)中,Multimodal Models(多模态模型) 通过处理和融合来自不同模态(如文本、图像、音频等)的数据,实现更加丰富、自然的理解和生成能力。这类模型的应用非常广泛,从视觉问答、图像生成到跨模态交互,正在改变我们与机器互动的方式。虽然多模态模型面临一些技术挑战,但其带来的潜力和机会是巨大的。

代码测试

使用python调用sonnet模型,来进行图片识别:

import boto3

import base64

import json

def encode_image_to_base64(image_path):

"""将图片文件转换为 base64 编码"""

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode('utf-8')

def analyze_image(image_path):

# 创建 Bedrock Runtime 客户端

bedrock = boto3.client(

service_name='bedrock-runtime',

region_name='us-east-1' # 替换为你的区域

)

# 准备图片

base64_image = encode_image_to_base64(image_path)

# 构建请求体

body = {

"anthropic_version": "bedrock-2023-05-31",

"max_tokens": 1000,

"messages": [

{

"role": "user",

"content": [

{

"type": "image",

"source": {

"type": "base64",

"media_type": "image/jpeg", # 根据实际图片格式调整

"data": base64_image

}

},

{

"type": "text",

"text": "Please describe what you see in this image in detail."

}

]

}

]

}

try:

# 调用 Claude model

response = bedrock.invoke_model(

modelId="anthropic.claude-3-sonnet-20240229-v1:0",

body=json.dumps(body)

)

# 解析响应

response_body = json.loads(response['body'].read())

description = response_body['content'][0]['text']

return description

except Exception as e:

print(f"Error analyzing image: {str(e)}")

return None

def main():

# 图片路径

image_path = "image.png" # 替换为你的图片路径

# 分析图片

result = analyze_image(image_path)

if result:

print("Image Analysis Result:")

print(result)

if __name__ == "__main__":

main()

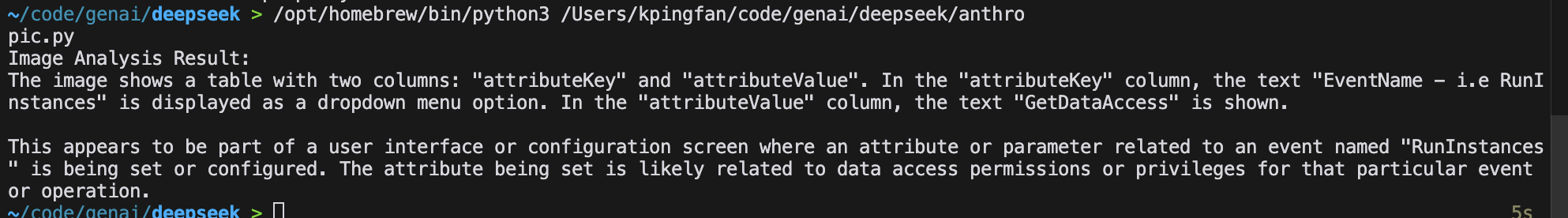

运行结果:

Golang版本的代码:

package main

import (

"bytes"

"context"

"encoding/base64"

"encoding/json"

"fmt"

"log"

"os"

"github.com/aws/aws-sdk-go-v2/aws"

"github.com/aws/aws-sdk-go-v2/config"

"github.com/aws/aws-sdk-go-v2/service/bedrockruntime"

)

// 请求体的结构体定义

type RequestBody struct {

AnthropicVersion string `json:"anthropic_version"`

MaxTokens int `json:"max_tokens"`

Messages []Message `json:"messages"`

}

type Message struct {

Role string `json:"role"`

Content []Content `json:"content"`

}

type Content struct {

Type string `json:"type"`

Source *ImageSource `json:"source,omitempty"`

Text string `json:"text,omitempty"`

}

type ImageSource struct {

Type string `json:"type"`

MediaType string `json:"media_type"`

Data string `json:"data"`

}

// ResponseBody 结构体定义

type ResponseBody struct {

Content []struct {

Text string `json:"text"`

} `json:"content"`

}

// 将图片转换为base64编码

func encodeImageToBase64(imagePath string) (string, error) {

// 读取图片文件

imageData, err := os.ReadFile(imagePath)

if err != nil {

return "", fmt.Errorf("读取图片失败: %v", err)

}

// 转换为base64

return base64.StdEncoding.EncodeToString(imageData), nil

}

// 分析图片

func analyzeImage(imagePath string) (string, error) {

// 加载AWS配置

cfg, err := config.LoadDefaultConfig(context.TODO(),

config.WithRegion("us-east-1"), // 替换为你的区域

)

if err != nil {

return "", fmt.Errorf("无法加载AWS配置: %v", err)

}

// 创建Bedrock Runtime客户端

client := bedrockruntime.NewFromConfig(cfg)

// 获取图片的base64编码

base64Image, err := encodeImageToBase64(imagePath)

if err != nil {

return "", err

}

// 构建请求体

requestBody := RequestBody{

AnthropicVersion: "bedrock-2023-05-31",

MaxTokens: 1000,

Messages: []Message{

{

Role: "user",

Content: []Content{

{

Type: "image",

Source: &ImageSource{

Type: "base64",

MediaType: "image/jpeg", // 根据实际图片格式调整

Data: base64Image,

},

},

{

Type: "text",

Text: "Please describe what you see in this image in detail.",

},

},

},

},

}

// 将请求体转换为JSON

jsonBody, err := json.Marshal(requestBody)

// fmt.Println(string(jsonBody))

if err != nil {

return "", fmt.Errorf("JSON编码失败: %v", err)

}

// 调用Claude模型

input := &bedrockruntime.InvokeModelInput{

ModelId: aws.String("anthropic.claude-3-sonnet-20240229-v1:0"),

Body: jsonBody,

ContentType: aws.String("application/json"),

}

response, err := client.InvokeModel(context.TODO(), input)

if err != nil {

return "", fmt.Errorf("调用模型失败: %v", err)

}

// 解析响应

var responseBody ResponseBody

if err := json.NewDecoder(bytes.NewReader(response.Body)).Decode(&responseBody); err != nil {

return "", fmt.Errorf("解析响应失败: %v", err)

}

if len(responseBody.Content) > 0 {

return responseBody.Content[0].Text, nil

}

return "", fmt.Errorf("响应中没有内容")

}

func main() {

// 图片路径

imagePath := "image.png" // 替换为你的图片路径

// 分析图片

result, err := analyzeImage(imagePath)

if err != nil {

log.Fatalf("分析图片失败: %v", err)

}

fmt.Println("图片分析结果:")

fmt.Println(result)

}